ZLG深度解析——人臉識別核心技術

隨著計算機技術以及光學成像技術的發展,集成了人工智能、機器學習、視頻圖像處理等技術的人臉識別技術也逐漸成熟。未來五年,我國人臉識別市場規模平均復合增長率將達到25%,到2021年人臉識別市場規模將達到51億元左右,具有巨大的市場需求與前景。

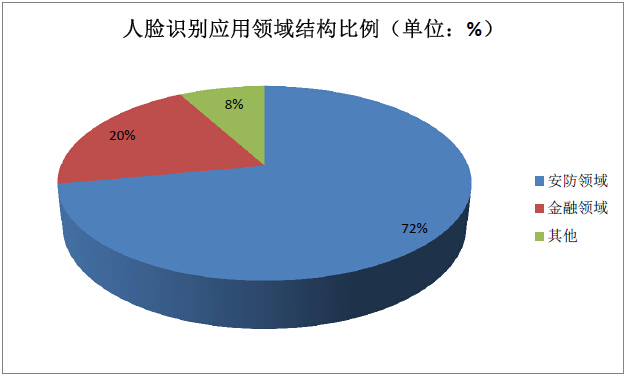

安防、金融是人臉識別切入細分行業較深的兩個領域,移動智能硬件終端成為人臉識別新的快速增長點。因此,這三大領域將是人臉識別快速增長的最大驅動力。

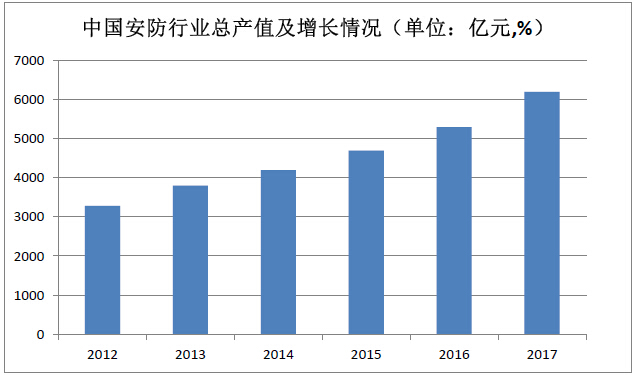

2017年,我國安防行業總產值達到6200億,同比增長16.98%,維持強勁發展勢頭。從細分產業來看,視頻監控是構建安防系統中的核心,在中國的安防產業中所占市場份額最大。而人臉識別在視頻監控領域具有相當的優勢,應用前景廣闊。

市面上的人臉識別解決方案也越來越多,但在系統框架上基本大同小異,大體框架如下圖所示:

接下來對人臉識別算法各技術點逐一進行詳細介紹,包括人臉檢測、人臉定位、人臉校準、人臉比對、人臉反欺詐以及算法優化等。

1. 人臉檢測

人臉檢測算法繁多,我們采用由粗到精的高效方式,即先用計算量小的特征快速過濾大量非人臉窗口圖像,然后用復雜特征篩選人臉。這種方式能快速且高精度的檢測出正臉(人臉旋轉不超過45度)。該步驟旨在選取最佳候選框,減小非人臉區域的處理,從而減小后續人臉校準及比對的計算量。

以下為人臉檢測算法的初始化接口,根據實際應用場景設置人臉的相關參數,包括最小人臉尺寸、搜索步長、金字塔縮放系數等:

人臉檢測實測效果如下圖所示:

在人臉檢測領域比較權威的測試集FDDB上進行評測, 100誤檢時的召回率達到85.2%, 1000誤檢時的召回率達到89.3%。

2. 人臉定位

面部特征點定位在人臉識別、表情識別、人臉動畫等人臉分析任務中至關重要的一環。人臉定位算法需要選取若干個面部特征點,點越多越精細,但同時計算量也越大。兼顧精確度和效率,我們選用雙眼中心點、鼻尖及嘴角五個特征點。經測試,它們在表情、姿態、膚色等差異上均表現出很好的魯棒性。

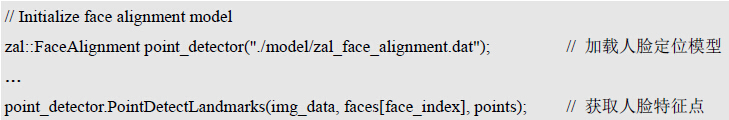

人臉定位接口程序如下所示,需要先加載預先訓練好的模型,再進行定位檢測:

人臉定位程序的效果如下所示:

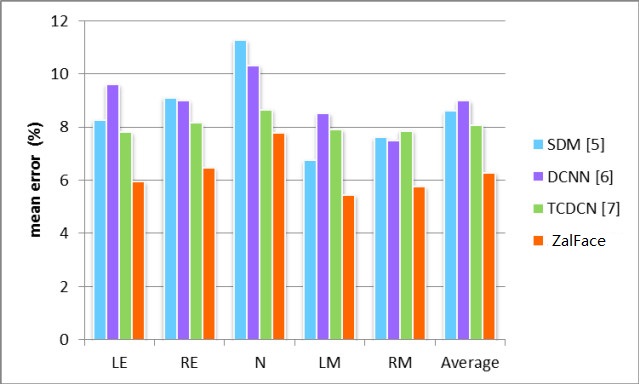

本算法在AFLW數據集上的定位誤差及與其他算法的對比情況:

3. 人臉校準

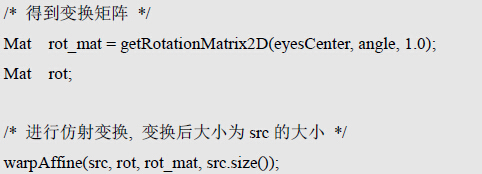

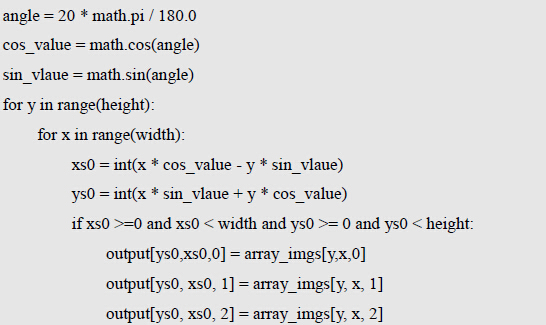

本步驟目的是擺正人臉,將人臉置于圖像中央,減小后續比對模型的計算壓力,提升比對的精度。主要利用人臉定位獲得的5個特征點(人臉的雙眼、鼻尖及嘴角)獲取仿射變換矩陣,通過仿射變換實現人臉的擺正。 目標圖形以(x,y)為軸心順時針旋轉Θ弧度,變換矩陣為:

人臉校準C++代碼可參考如下所示:

一般此步驟不建議使用外部庫做變換,所以這里提供仿射變換python源碼以供參考:

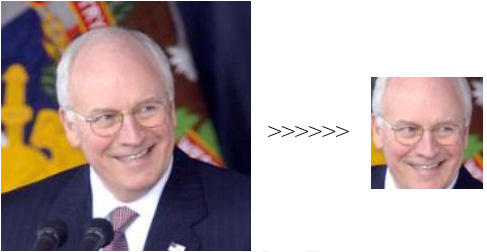

人臉校準的效果如圖所示:

4. 人臉比對

人臉比對和人臉身份認證的前提是需要提取人臉獨有的特征點信息。在人臉校準之后可以利用深度神經網絡,將輸入的人臉進行特征提取。如將112×112×3的臉部圖像提取256個浮點數據特征信息,并將其作為人臉的唯一標識。在注冊階段把256個浮點數據輸入系統,而認證階段則提取系統存儲的數據與當前圖像新生成的256個浮點數據進行比對最終得到人臉比對結果。

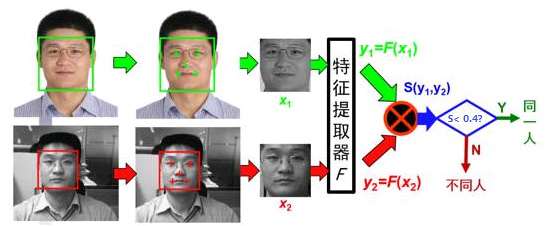

人臉比對流程的示意圖如下所示:

通過神經網絡算法得到的特征點示意圖如下:

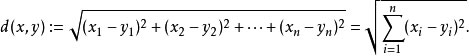

而人臉比對則是對256個浮點數據之間進行距離運算。計算方式常用的有兩種,一種是歐式距離,一種是余弦距離。x,y向量歐式距離定義如下:

x,y向量之間余弦距離定義如下:

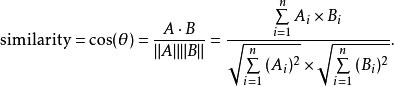

余弦距離或歐式距離越大,則兩個特征值相似度越低,屬于同一個人的可能性越小。如下圖,他們的臉部差異值為0.4296 大于上文所說的該模型最佳閾值0.36,此時判斷兩人為不同的人,可見結果是正確的。

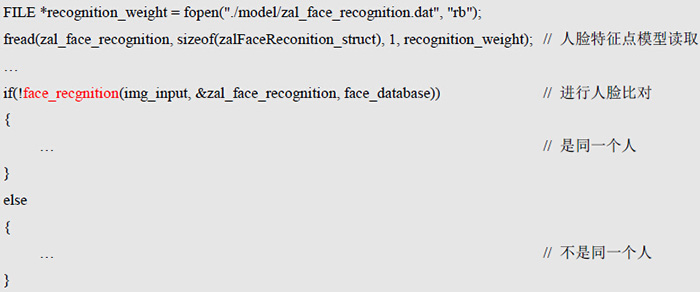

把歸一化為-1到1的圖像數據、特征點提取模型的參數還有人臉數據庫輸入到人臉比對的函數接口face_recgnition,即可得人臉認證結果。程序接口的簡單調用方式如下所示:

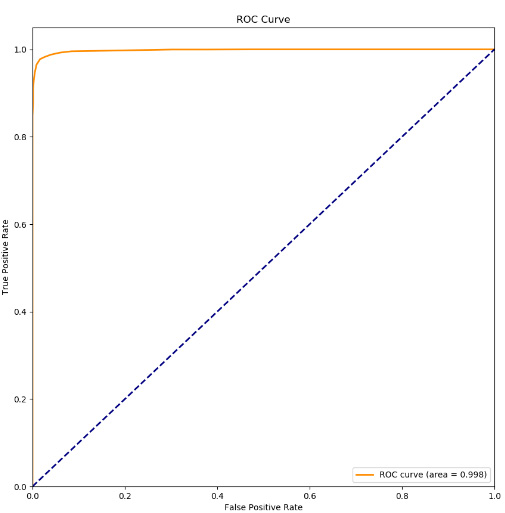

人臉比對算法的準確率方面是以查準率為保證的,AUC (Area under curve)=0.998,ROC

| 模型 | ZalFace | dlib | Resnet-18 |

曲線圖如下所示:

我們設計的比對模型主要特點是模型參數少、計算量少并能保證高的準確率,一定程度上適合在嵌入端進行布置。對比其他人臉比對模型差異如下表格所示:

| 參數量(parameter) | 3.7M | 5.0M | 11.07M |

| 理論浮點計算量(Flops) | 50M | 310M | 1372M |

| lfw | 98.12+-0.76% | 97.58+-0.80% | 99.10+-0.40% |

| lfw far@1e-3 | 90.47+-2.80% | 90.23+-2.37% | 93.68+-6.6% |

| agedb_30 | 88.71+-2.35% | 90.56+-1.84% | 88.95+-0.41% |

| agedb_30 far@1e-3 | 32.50+-4.41% | 35.73%+-6.41% | 25.67+-3.38% |

| cfp_ff | 97.84+-0.70% | 97.89+-1.08% | 98.49+-0.41% |

| cfp_ff far@ 1e-3 | 90.85+-2.36% | 87.86+-2.40% | 87.80+-3.48% |

(1)far@1e-3表示將反例判定為正例的概率控制在千分之一以下時,模型仍能保持的準確率;

(2)dlib在實際測試中,存在detector檢測不出人臉的情況,導致最終效果與官網上有一定差異;

(3)resnet-18為pytorch的playground標準模型;

(4)lfw/agedb_30/cfp_ff為標準人臉比對測試庫,測試過程中圖片已經過人臉居中處理。

5. 人臉反欺詐

從技術角度來說,人臉是唯一不需要用戶配合就可以采集的生物特征信息。人臉不同于指紋、掌紋、虹膜等,用戶不愿意被采集信息就無法獲得高質量的特征信息。人臉信息簡單易得,而且質量還好,所以這引發了有關個人數據安全性的思考。而且在沒有設計人臉反欺詐算法的人臉識別系統使用手機、ipad或是打印的圖片等都能對輕松欺騙系統。

所以我們采用多傳感器融合技術的方案,使用紅外對管與圖像傳感器數據進行深度學習來判斷是否存在欺詐。紅外對管進行用戶距離的判斷,距離過近則懷疑欺詐行為。圖像傳感器用深度學習算法進行二分類,把正常用戶行為與欺詐用戶行為分為兩類,對欺詐用戶進行排除。

二分類算法能夠有效抵抗一定距離的手機、ipad或是打印圖片的欺詐攻擊。對人臉欺詐數據集與普通人臉數據集預測如圖所示:

本二分類算法在100萬張圖片中準確分類的概率為98.89%,所以并不會對整體系統的準確率進行影響,保障系統的可靠性。

6. 算法優化

在使用神經網絡算法解決問題的時候,算法效率問題是必要的考量的。特別是在資源與算力不足的嵌入式端,更是頭等大問題。除了依托TensorFlow、Keras等開源框架,根據其前向傳播的原理寫成C++程序,還有必要的編譯優化外,模型權重參數的清洗和算法計算的向量化都是比較有效的手段。

1) 模型權重參數清洗

權重參數清洗對神經網絡算法的效率影響相當大,沒有進行清洗的權重參數訪問與操作非常低效,與清洗后的權重參數相比往往能效率相差6-8倍。這差距在算力不足的嵌入式端非常明顯,往往決定一個算法是否能落地。具體的方法就是先讀取原模型進行重組,讓參數變得緊湊且能在計算時連續訪問計算,最后獲得重組后的模型與對應的重組模型的計算方法。這個步驟需要一定的優化實踐經驗以達到滿意的效果,對模型讀取效率與運算效率都會有顯

2) 算法計算向量化

對于算法的向量化的做法就是讓算法的計算能夠使用向量乘加等運算,而特別是在使用神經網絡算法情況下,大量的計算沒有前后相關性且執行相類似的步驟,所以向量化計算會對算法有明顯的提升,一般能把算法效率提升三倍左右。

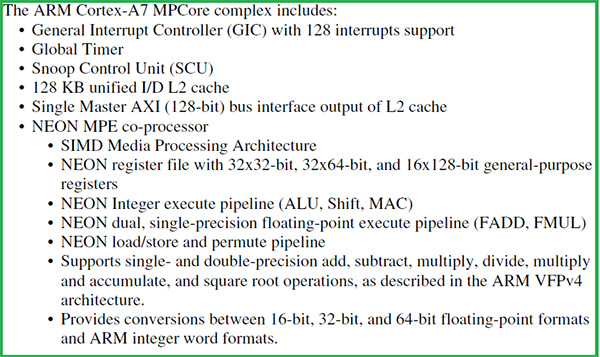

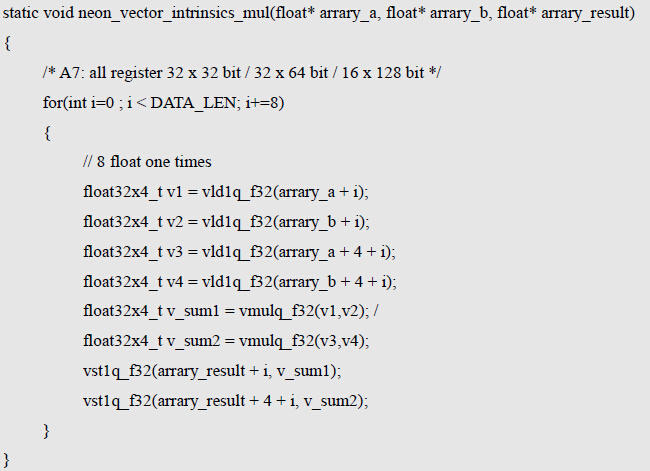

使用NEON指令集的SIMD指令取代Arm?通用的SISD指令,是一個常用的算法向量化方法。在基于Arm?V7-A和Arm?V7-R的體系架構上基本采用了NEON技術,Arm?V8也支持并與Arm?V7兼容。

以IMX6ULL芯片為例,可以通過查閱官方的參考手冊查看其NEON相關信息:

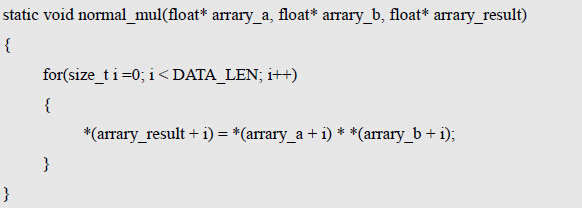

下面舉例說明普通的編程寫法與NEON instrinsics編程、NEON assembly編程區別。以下為普通的編程寫法:

| 無冗余 | 飽和 | 順序 | 訪存模式 |

| T | T | T | 無冗余飽和順序模式 |

| T | T | F | 無冗余飽和亂序模式 |

| T | F | T | 無冗余非飽和順序模式 |

| T | F | F | 無冗余非飽和亂序模式 |

| F | T | T | 冗余飽和順序模式 |

| F | T | F | 冗余飽和亂系模式 |

| F | F | T | 冗余非飽和順序模式 |

| F | F | F | 冗余非飽和亂序模式 |

一般NEONinstrinsics已經能做到三倍的提速效果,而NEONassembly效果會更好一些。但是程序向量化需要特殊訪存規則,如果不符合則會對導致提速效果大打折扣。

訪存特征詳細分類如表所示:

其中,無冗余飽和順序模式是理想的訪問模式,能夠發揮算法計算向量化的效果。但是我們神經網絡算法的最基本的卷積、全連接等計算卻是冗余飽和非順序模式的計算,這要如何解決呢?

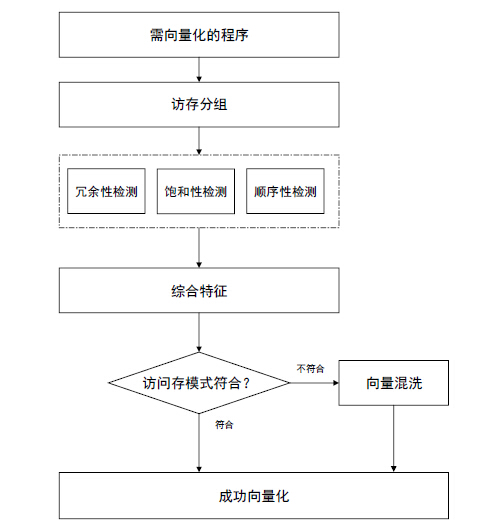

查閱相關論文、期刊對這程序向量化非規則訪存的研究,可以發現程序向量化有以下步驟:

如上圖所示,需要對卷積、全連接等冗余飽和非順序模式計算通過向量混洗為無冗余飽和順序的模式,以達到優化的效果。

7.人臉識別效果展示

基于PC的人臉識別展示demo如下視頻所示:

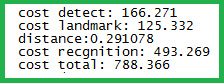

我們的人臉識別算法已經成功移植到了Cortex?-a7的EPC-6Y2C-L平臺,并已經進行了一定的優化,后面會進行進一步的優化。人臉檢測效率為166ms左右,人臉定位效率為125ms左右,人臉比對的效率為493ms左右,合計人臉識別總耗時788.3ms左右。下面是在EPC-6Y2C-L的實測效果: